人形機器人的步態及平衡控制具有較高技術難度。人形機器人在移動時只受自身重力和地面作用力兩方面外力,但機器人只能通過控制關節驅動力來控制步態,帶來了研發的極大難度。

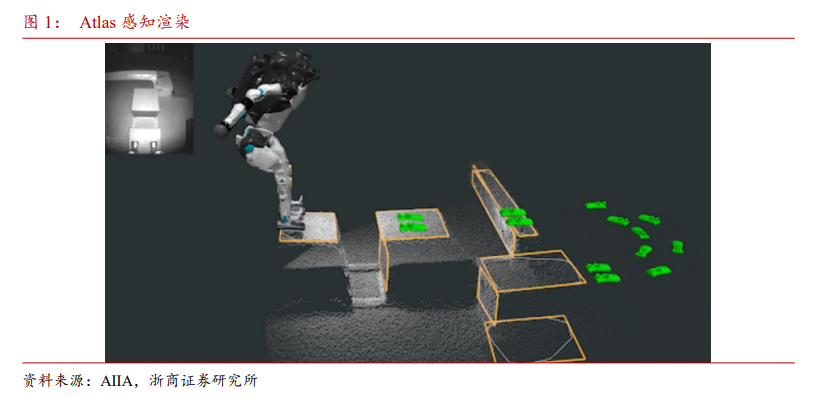

TOF(Time of Flight)深度相機,增加了像素 Z 軸的景深信息,也被稱為 3D TOF。給目標發送連續光脈沖,通過傳感器接收物體反射光,計算發射和反射時間差或相位差,來換算目標距離以及深度信息,再結合傳統相機拍攝,以不同顏色代表不同距離的地形圖方式呈現目標的三維輪廓。

特斯拉人形機器人感知視覺技術為自動駕駛純視覺系統的遷移,發展相對成熟,具商業化規模成本優勢。特斯拉視覺模塊采用處理原始信息的神經網絡,即純視覺系統。借鑒Google Transformer 模型,搭建 HydraNet 神經網絡模型,優化視覺算法。它獲取密集的視頻數據,將其壓縮到 3D 向量空間。實時處理攝像頭傳輸的圖像,轉換為向量信息。形成所需要的全部三維空間信息,包括線條、邊緣、路沿、交通指示、交通燈、位置、方向、深度、速度等。