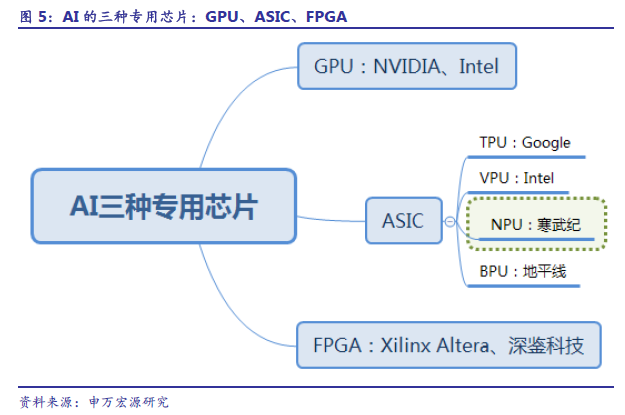

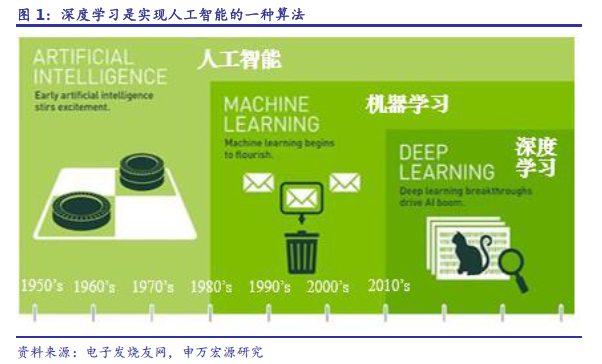

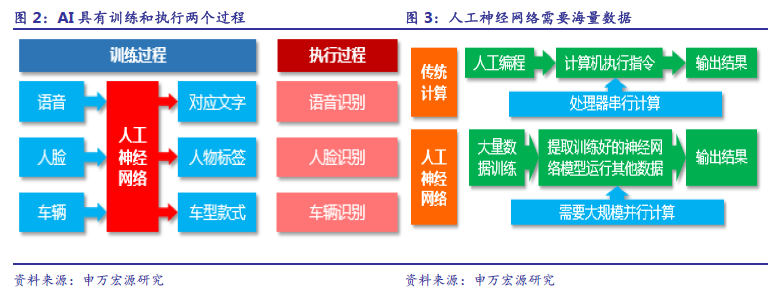

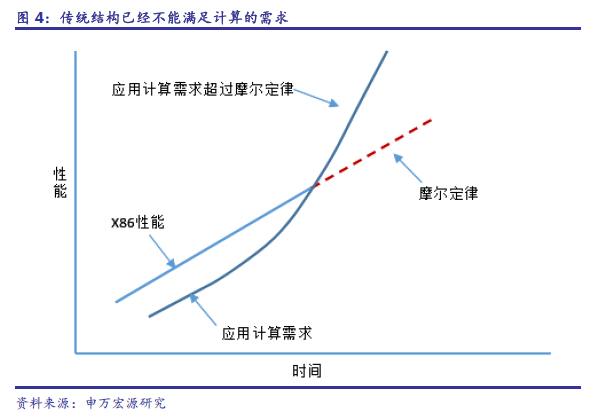

AI 加速需求超過CPU 計算能力摩爾定律供給。人工智能的三大支撐是硬件、算法和數據,其中硬件指的是運行AI 算法的芯片與相對應的計算平臺1。在硬件方面,目前主要是使用GPU 并行計算神經網絡,同時,FPGA 和ASIC 也具有未來異軍突起潛能。目前AI 芯片按照使用場景可以分為:云端(服務器端)和終端(移動端)芯片。云端主要指公有云、私有云、數據中心等需要用到的神經網絡專用服務器,終端指手機、車載、安防、音響、機器人等移動應用終端。有的廠商同時具備云端和終端芯片的設計能力。

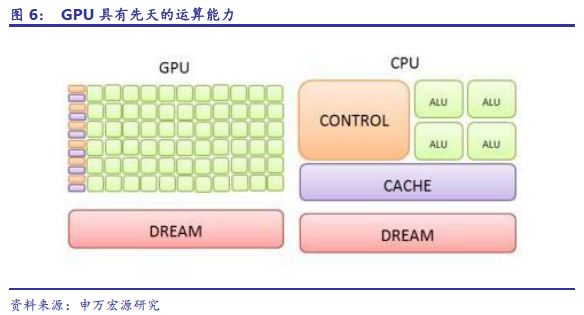

GPU 將最早受益于安防等需求爆發。GPU:圖形加速起家,較成熟生態系統,最先被引入深度學習。GPU(GraphicsProcessing Unit)稱為圖形處理器,它是顯卡的“心臟”,與CPU 類似,只不過是一種專門進行圖像運算工作的微處理器。GPU 是專為執行復雜的數學和幾何計算而設計的,這些計算是圖形渲染所必需的。GPU 在浮點運算、并行計算等部分計算方面可以提供數十倍乃至于上百倍于CPU 的性能。英偉達公司從2006 年下半年已經開始陸續推出相關的硬件產品以及軟件開發工具,目前是人工智能硬件市場的主導。GPU 對海量數據并行運算的能力與深度學習需求不謀而合,因此,被最先引入深度學習。2011 年吳恩達教授率先將其應用于谷歌大腦中便取得驚人效果,結果表明,12 顆英偉達的GPU 可以提供相當于2000顆CPU 的深度學習性能。

FPGA:能效居中的中間方案。FPGA:能效中等、靈活度高、成本較高的AI 白板。FPGA(Field-ProgrammableGate Array)稱為現場可編程門陣列,用戶可以根據自身的需求進行重復編程。FPGA 比GPU 具有更低的功耗,比ASIC 具有更短的開發時間和更低的成本。自Xilinx 在1984 年創造出FPGA 以來,在通信、醫療、工控和安防等領域占有一席之地,在過去幾年也有極高的增長率。而進入了最近兩年,由于云計算、高性能計算和人工智能的繁榮,擁有先天優勢的FPGA 的關注度更是到達了前所未有的高度。