深度學習是一種數據建模的隱含分布的多層表達機器學習算法。簡單來說,就是自動提取分類中所需要的多層次(高、低)的特征集。因此,深度學習能夠更好的表達數據的特征。同時,由于模型的層次、參數很多,深度學習能夠對大規模數據進行學習表達,比如在圖像、語音等特征不明顯的領域,可以在大規模訓練數據的基礎上取得很好的學習效果。

深度學習可以借助類人腦網狀結構的神經網絡,解決很多實際問題。例如:圖像搜索,人臉識別,實時翻譯和語言識別等等。而強化學習則進一步推動深度學習,比如游戲,可以通過強化學習,自我競賽,實現自我進化。近幾年,大型語言模型取得了巨大進步。 2019 年,OpenAI 的 GPT2 成為第一個擁有超過 10 億個參數的模型;2020 年,GPT3 風靡 AI 社區,它擁有 1750 億個參數;2021 年,谷歌 SwitchTransformer 模型(1.6 萬億參數)和北京智源研究院“悟道”(1.75 萬億參數)模型打破萬億參數規模。未來,大型語言模型的規模肯定還將繼續增長,比如:OpenAI的 GPT4(ChatGPT 是 GPT3.5)。

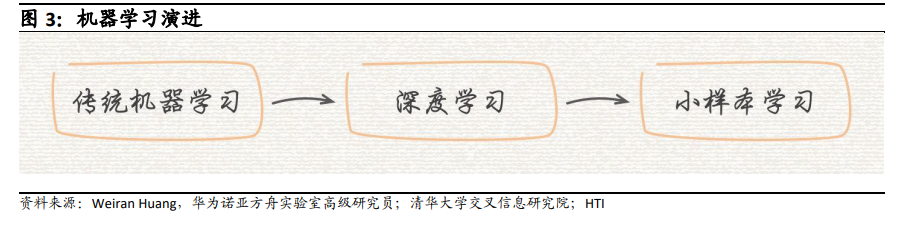

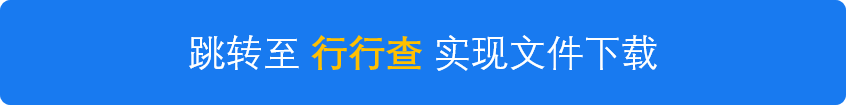

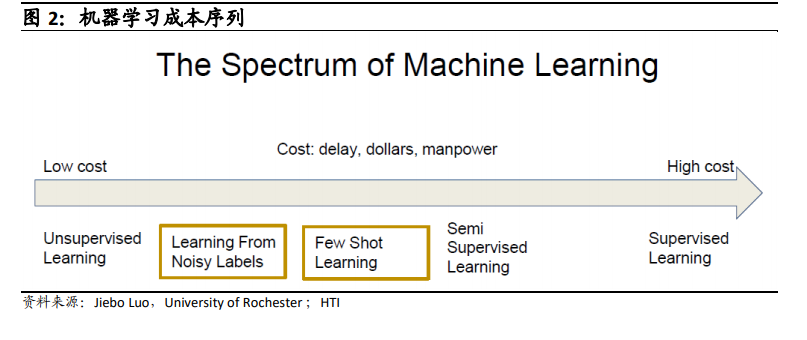

深度學習確實對人工智能起到了巨大的推動作用,但同時,其也存在著天生的缺陷。一直以來,人工智能都依賴大量的數據進行模型訓練,但這帶來了過度收集個人數據、數據標注工作量大,數據領域存在“數據孤島”等問題。 深度學習是基于大數據,通過多層網絡實現對“抽象概念”的理解,數據越多其效果相應就越好。而對于人類來說,推理是一項天生技能,只需要從少量數據樣本中學習,利用特征+推理的方法往往就可以進行有效的判別,這就是人類舉一反三的能力,即便沒有過去的知識積累,專業知識欠缺,也有 “照貓畫虎”的可能性。從這個角度來說,以深度學習為核心的人工智能還遠遠不及人類,人類面對陌生環境依然能夠通過學習做出適應變化。因此,“類人智能學習”首先要解決深度學習的這種弊端,即不依賴大數據也能進行自我學習。